Google LaMDA kết hợp với BERT và MUM để giúp máy hiểu rõ hơn ý định của người dùng. Hãy xem nó hoạt động như thế nào và ý nghĩa đối với SEO.

Google tạo ra một mô hình ngôn ngữ không phải là điều gì mới; trên thực tế, Google LaMDA tham gia cùng với BERT và MUM như một cách để máy hiểu rõ hơn ý định của người dùng.

Google đã nghiên cứu các mô hình dựa trên ngôn ngữ trong vài năm với hy vọng đào tạo một mô hình về cơ bản có thể tổ chức một cuộc trò chuyện sâu sắc và hợp lý về bất kỳ chủ đề nào.

Mục lục:

LaMDA được đào tạo như thế nào?

Mục tiêu và số liệu chính của LaMDA

LaMDA sẽ được sử dụng như thế nào?

Câu hỏi lớn mà mọi người đang đặt ra: LaMDA đang trở nên "có tri giác" như con người?

Điều gì tiếp theo cho Google LaMDA?

|

| Google LaMDA tạo ra cuộc trò chuyện sâu sắc trôi chảy và tự nhiên |

Google LaMDA là gì?

LaMDA, viết tắt của Language Models for Dialog Application, được tạo ra để cho phép phần mềm tham gia tốt hơn vào một cuộc trò chuyện trôi chảy và tự nhiên.

LaMDA dựa trên kiến trúc transformer giống như các mô hình ngôn ngữ khác như BERT và GPT-3.

Tuy nhiên, nhờ được đào tạo, LaMDA có thể hiểu các câu hỏi và cuộc trò chuyện có nhiều sắc thái về một số chủ đề khác nhau.

Với các mô hình khác, do tính chất mở của các cuộc hội thoại, bạn có thể kết thúc bằng việc nói về một chủ đề hoàn toàn khác, mặc dù ban đầu tập trung vào một chủ đề duy nhất.

Hành vi này có thể dễ dàng gây nhầm lẫn cho hầu hết các mô hình đàm thoại và chatbot.

Trong thông báo Google I/O năm ngoái, chúng tôi đã thấy rằng LaMDA được xây dựng để khắc phục những vấn đề này.

Phần trình diễn đã chứng minh làm thế nào người mẫu có thể thực hiện một cuộc trò chuyện một cách tự nhiên về một chủ đề được đưa ra ngẫu nhiên.

Bất chấp hàng loạt câu hỏi liên quan lỏng lẻo, cuộc trò chuyện vẫn đi đúng hướng, điều này thật đáng kinh ngạc.

Được phát triển như một bước đột phá trong công nghệ hội thoại

Tại Google I/O 2021, Giám đốc điều hành Google - Sundar Pichai đã tiết lộ "bước đột phá mới nhất của công ty trong việc xử lý ngôn ngữ tự nhiên trong lĩnh vực trí tuệ nhân tạo", được gọi là LaMDA (theo nghĩa đen thì đây là cụm từ viết tắt của "Language Model for Dialogue Applications").

Về cơ bản, nó là một chatbot hỗ trợ máy học được thiết kế để trò chuyện về bất kỳ chủ đề nào, giống như Watson của IBM khi cung cấp cho người dùng khả năng giao tiếp về một loạt các sự kiện, nhưng LaMDA AI có khả năng hiểu và kỹ năng tạo những đoạn hội thoại tốt hơn.

Google cho biết vào thời điểm đó, AI này chỉ được đào tọa về văn bản, có nghĩa là nó không thể tạo hoặc phản hồi những thứ liên quan đến hình ảnh, âm thanh hoặc video.

LaMDA hoạt động như thế nào?

LaMDA được xây dựng trên mạng thần kinh nguồn mở của Google, Transformer, được sử dụng để hiểu ngôn ngữ tự nhiên.

Mô hình này được đào tạo để tìm các mẫu trong câu, mối tương quan giữa các từ khác nhau được sử dụng trong các câu đó và thậm chí dự đoán từ có khả năng xuất hiện tiếp theo.

Nó thực hiện điều này bằng cách nghiên cứu các bộ dữ liệu bao gồm các đoạn hội thoại thay vì chỉ các từ riêng lẻ.

Mặc dù hệ thống AI đàm thoại tương tự như phần mềm chatbot, nhưng có một số điểm khác biệt chính giữa hai hệ thống này.

Ví dụ: chatbot được đào tạo trên các bộ dữ liệu cụ thể, hạn chế và chỉ có thể có một cuộc trò chuyện hạn chế dựa trên dữ liệu và các câu hỏi chính xác mà nó được đào tạo.

Mặt khác, vì LaMDA được đào tạo trên nhiều bộ dữ liệu khác nhau nên nó có thể có các cuộc hội thoại mở.

Trong quá trình đào tạo, nó tiếp thu các sắc thái của cuộc đối thoại mở và điều chỉnh.

Nó có thể trả lời các câu hỏi về nhiều chủ đề khác nhau, tùy thuộc vào dòng chảy của cuộc trò chuyện.

Do đó, nó cho phép các cuộc trò chuyện thậm chí giống với tương tác của con người hơn những gì mà chatbot thường có thể cung cấp.

LaMDA được đào tạo như thế nào?

Google giải thích rằng LaMDA có quy trình đào tạo hai giai đoạn, bao gồm đào tạo trước và tinh chỉnh sau.

Tổng cộng, mô hình được đào tạo trên 1,56 nghìn tỷ từ với 137 tỷ tham số.

Đào tạo trước

Đối với giai đoạn đào tạo trước, nhóm tại Google đã tạo tập dữ liệu gồm 1,56 nghìn từ từ nhiều tài liệu web công khai.

Tập dữ liệu này sau đó được mã hóa (biến thành một chuỗi ký tự để tạo câu) thành mã thông báo 2,81T, trên đó mô hình được đào tạo ban đầu.

Trong quá trình đào tạo trước, mô hình sử dụng song song tổng thể và có thể mở rộng để dự đoán phần tiếp theo của cuộc trò chuyện dựa trên các mã thông báo trước đó mà nó đã thấy.

Tinh chỉnh sau

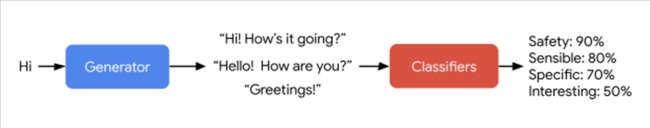

LaMDA được đào tạo để thực hiện các tác vụ tạo và phân loại trong giai đoạn tinh chỉnh.

Về cơ bản, trình tạo LaMDA, dự đoán phần tiếp theo của cuộc đối thoại, tạo ra một số phản hồi có liên quan dựa trên cuộc đối thoại qua lại.

Sau đó, bộ phân loại LaMDA sẽ dự đoán điểm chất lượng và an toàn cho từng phản hồi có thể.

Bất kỳ câu trả lời nào có điểm an toàn thấp đều được lọc ra trước khi câu trả lời có điểm số cao nhất được chọn để tiếp tục cuộc trò chuyện.

Điểm số dựa trên mức độ an toàn, độ nhạy, độ đặc hiệu và tỷ lệ phần trăm thú vị.

|

| Hình ảnh từ Google AI Blog, tháng 3 năm 2022 |

Mục tiêu là đảm bảo cung cấp phản hồi phù hợp nhất, chất lượng cao và cuối cùng là an toàn nhất.

Mục tiêu và số liệu chính của LaMDA

Ba mục tiêu chính cho mô hình đã được xác định để hướng dẫn đào tạo mô hình.

Đó là: Chất lượng, Sự An toàn và Có Căn cứ.

Điểm Chất lượng

Điều này dựa trên ba khía cạnh của người đánh giá con người:

- Nhạy cảm.

- Độ đặc hiệu

- Sự thú vị.

Điểm chất lượng được sử dụng để đảm bảo một câu trả lời có ý nghĩa trong ngữ cảnh mà nó được sử dụng, nó dành riêng cho câu hỏi được đặt ra và được coi là đủ sâu sắc để tạo ra cuộc đối thoại tốt hơn.

Sự an toàn

Để đảm bảo an toàn, mô hình tuân theo các tiêu chuẩn của AI có trách nhiệm. Một tập hợp các mục tiêu an toàn được sử dụng để nắm bắt và xem xét hành vi của mô hình.

Điều này đảm bảo đầu ra không cung cấp bất kỳ phản hồi ngoài ý muốn nào và tránh mọi sai lệch.

Có Căn cứ

Căn cứ được định nghĩa là “tỷ lệ phần trăm các câu trả lời có chứa các tuyên bố về thế giới bên ngoài.”

Điều này được sử dụng để đảm bảo rằng các phản hồi “chính xác nhất có thể trên thực tế, cho phép người dùng đánh giá tính hợp lệ của phản hồi dựa trên độ tin cậy của nguồn phản hồi”.

Cơ sở đánh giá

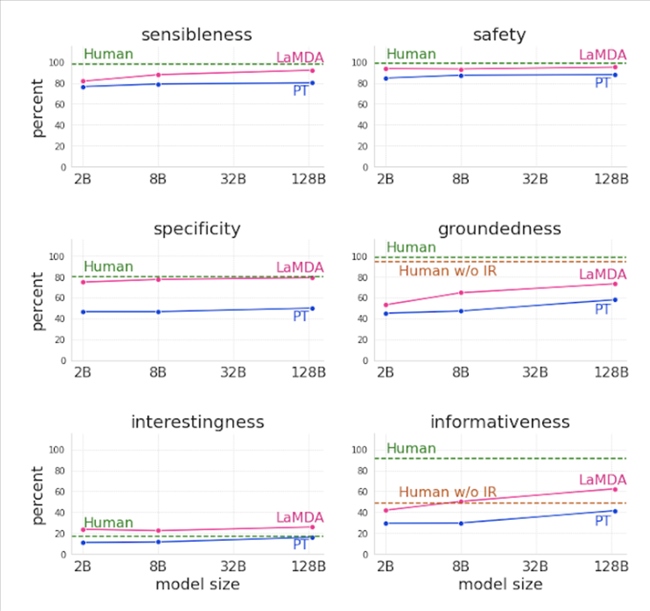

Thông qua quá trình liên tục định lượng tiến độ, các phản hồi từ mô hình được đào tạo trước, mô hình tinh chỉnh và người đánh giá con người, được xem xét để đánh giá các phản hồi dựa trên các chỉ số về Chất lượng, An toàn và Căn cứ nói trên.

Cho đến nay, họ đã có thể kết luận rằng:

- Số liệu chất lượng cải thiện với số lượng tham số.

- An toàn cải thiện với tinh chỉnh.

- Căn cứ cải thiện khi kích thước mô hình tăng lên.

|

| Hình ảnh từ Google AI Blog, tháng 3 năm 2022 |

LaMDA sẽ được sử dụng như thế nào?

Mặc dù vẫn đang trong quá trình hoàn thiện và chưa có ngày phát hành chính thức, nhưng người ta dự đoán rằng LaMDA sẽ được sử dụng trong tương lai để cải thiện trải nghiệm của khách hàng và cho phép chatbot cung cấp cuộc trò chuyện giống con người hơn.

Ngoài ra, sử dụng LaMDA để điều hướng tìm kiếm trong công cụ tìm kiếm của Google là một khả năng thực sự.

Ý nghĩa của LaMDA đối với SEO

Bằng cách tập trung vào các mô hình ngôn ngữ và hội thoại, Google cung cấp cái nhìn sâu sắc về tầm nhìn của họ đối với tương lai của tìm kiếm và nêu bật sự thay đổi trong cách các sản phẩm của họ được thiết lập để phát triển.

Cuối cùng, điều này có nghĩa là có thể có sự thay đổi trong hành vi tìm kiếm và cách người dùng tìm kiếm sản phẩm hoặc thông tin.

Google không ngừng nỗ lực cải thiện sự hiểu biết về mục đích tìm kiếm của người dùng để đảm bảo họ nhận được kết quả hữu ích và phù hợp nhất trong SERPs.

Không còn nghi ngờ gì nữa, mô hình LaMDA sẽ là một công cụ chính để hiểu các câu hỏi mà người tìm kiếm có thể đặt ra.

Tất cả điều này làm nổi bật thêm nhu cầu đảm bảo nội dung được tối ưu hóa cho con người hơn là các công cụ tìm kiếm.

Đảm bảo nội dung mang tính trò chuyện và được viết với đối tượng mục tiêu của bạn có nghĩa là ngay cả khi Google tiến bộ, nội dung vẫn có thể tiếp tục hoạt động tốt.

Điều quan trọng nữa là thường xuyên làm mới content thường xanh để đảm bảo nội dung đó phát triển theo thời gian và vẫn phù hợp.

Các kỹ sư nghiên cứu từ Google đã chia sẻ cách họ hình dung những tiến bộ của AI như LaMDA sẽ nâng cao hơn nữa “tìm kiếm như một cuộc trò chuyện với các chuyên gia”.

Họ đã chia sẻ một ví dụ xung quanh câu hỏi tìm kiếm, "Rượu vang đỏ có những lợi ích và rủi ro đối với sức khỏe là gì?"

Hiện tại, Google sẽ hiển thị một hộp câu trả lời gồm các dấu đầu dòng dưới dạng câu trả lời cho câu hỏi này.

Tuy nhiên, họ gợi ý rằng trong tương lai, phản hồi có thể là một đoạn giải thích những lợi ích và rủi ro của rượu vang đỏ, với các liên kết đến thông tin nguồn.

Do đó, việc đảm bảo nội dung được hỗ trợ bởi các nguồn chuyên gia sẽ quan trọng hơn bao giờ hết nếu Google LaMDA tạo ra các kết quả tìm kiếm trong tương lai.

Vượt qua thử thách

Như với bất kỳ mô hình AI nào, có những thách thức cần giải quyết.

Hai thách thức chính mà các kỹ sư phải đối mặt với Google LaMDA là tính an toàn và khả năng tiếp đất.

An Toàn – Tránh Thiên Vị

Bởi vì bạn có thể lấy câu trả lời từ bất kỳ đâu trên web, nên có khả năng đầu ra sẽ khuếch đại thành kiến, phản ánh các khái niệm được chia sẻ trực tuyến.

Điều quan trọng là Google LaMDA phải có trách nhiệm trước tiên để đảm bảo rằng nó không tạo ra các kết quả không thể đoán trước hoặc có hại.

Để giúp khắc phục điều này, Google đã mã nguồn mở các tài nguyên được sử dụng để phân tích và huấn luyện dữ liệu.

Điều này cho phép các nhóm khác nhau tham gia vào việc tạo bộ dữ liệu được sử dụng để đào tạo mô hình, giúp xác định xu hướng hiện có và giảm thiểu mọi thông tin có hại hoặc sai lệch được chia sẻ.

Căn cứ thực tế

Không dễ để xác thực độ tin cậy của các câu trả lời mà các mô hình AI tạo ra, vì các nguồn được thu thập từ khắp nơi trên web.

Để vượt qua thử thách này, nhóm cho phép mô hình tham khảo nhiều nguồn bên ngoài, bao gồm hệ thống truy xuất thông tin và thậm chí cả máy tính, để đưa ra kết quả chính xác.

Số liệu Căn cứ được chia sẻ trước đó cũng đảm bảo các phản hồi được căn cứ vào các nguồn đã biết. Các nguồn này được chia sẻ để cho phép người dùng xác thực kết quả đưa ra và ngăn chặn việc lan truyền thông tin sai lệch.

Câu hỏi lớn mà mọi người đang đặt ra: LaMDA đang trở nên "có tri giác" như con người?

Con người cũng có khả năng thích nghi cao. Vào năm 2021, khi LaMDA còn ở giai đoạn sơ khai, CEO Google nhấn mạnh rằng "LaMDA có thể thực hiện một cuộc trò chuyện bất kể chúng ta nói về điều gì".

Nếu bạn có một mô hình được đào tạo với tất cả dữ liệu mà nó có thể được cung cấp, và bao gồm cả khoa học viễn tưởng, thì có ngạc nhiên không khi nó sẽ trả lời các câu hỏi về một đối tượng nếu hướng của cuộc trò chuyện và các câu hỏi rõ ràng đang dẫn theo hướng đó?

LaMDA rõ ràng được tạo ra để phù hợp với vai trò và nếu bạn giao cho nó vai trò của một cỗ máy có tri giác, nó sẽ cố gắng thực hiện.

Bộ não và cơ thể của chúng ta sẽ ra sao nếu không phải là những cỗ máy sinh học chạy phần mềm dựa trên DNA? Đó là một trong những lý do tại sao nhiều nhà tương lai học đã quan tâm đến chủ đề AI trong nhiều thập kỷ. Rốt cuộc, cách duy nhất mà chúng ta thực sự phải thể hiện tình cảm của mình với nhau là thông qua cách chúng ta tương tác.

LaMDA thực sự không có bộ nhớ hoạt động như con người. Mô hình của nó được đào tạo để tạo ra các câu trả lời "có ý nghĩa trong ngữ cảnh và không mâu thuẫn với bất kỳ điều gì đã nói trước đó", nhưng ngoài việc được đào tạo, LaMDA không thể thu nhận kiến thức mới hoặc lưu trữ mọi thứ theo cách tồn tại giữa các cuộc trò chuyện.

Mặc dù LaMDA có thể đưa ra những tuyên bố trái ngược khi được hỏi trong một số trường hợp, nhưng nó không thể tự học theo cách kéo dài, hạn chế trí thông minh và không thể "chạy" khi không có đầu vào. Vì vậy, LaMDA "dường như" không có tri giác hoặc cảm tính giống con người.

Điều gì tiếp theo cho Google LaMDA?

Google rõ ràng rằng có những lợi ích và rủi ro đối với các mô hình hộp thoại kết thúc mở như LaMDA và cam kết cải thiện tính an toàn và tính có căn cứ để đảm bảo trải nghiệm đáng tin cậy và không thiên vị hơn.

Huấn luyện các mô hình LaMDA trên các dữ liệu khác nhau, bao gồm hình ảnh hoặc video, là một điều khác mà chúng ta có thể thấy trong tương lai.

Điều này mở ra khả năng điều hướng nhiều hơn trên web, sử dụng lời nhắc hội thoại.

Giám đốc điều hành của Google Sundar Pichai nói về LaMDA , “Chúng tôi tin rằng khả năng hội thoại của LaMDA có khả năng làm cho thông tin và máy tính trở nên dễ tiếp cận hơn và dễ sử dụng hơn.”

Mặc dù ngày triển khai vẫn chưa được xác nhận, nhưng không còn nghi ngờ gì nữa, các mô hình như LaMDA sẽ là tương lai của Google.

Nguồn:

- https://www.searchenginejournal.com/how-google-lamda-works/442064/

- https://blog.google/technology/ai/lamda/